Когда компании обучают ИИ на контенте, сгенерированном ИИ, производительность модели деградирует с каждым циклом. Расплата за эту ошибку уже наступает, отмечают опрошенные порталом InformationWeek эксперты.

Современные модели искусственного интеллекта становятся жертвами опасной уязвимости: отравления данных. Но кризис отравления данных вызван не только хакерами или злоумышленниками — или даже в основном не ими. Он вызван самими организациями. По мере того, как предприятия стремятся внедрить ИИ во все рабочие процессы, они незаметно и быстро заполняют свои внутренние базы данных сгенерированными ИИ сводками, электронными письмами, кодом и отчетами. Когда синтетический контент попадает в конвейеры обучения, используемые для создания и тонкой настройки моделей ИИ следующего поколения, происходит отравление данных.

Для многих организаций ИИ-трансформация, в которую они инвестировали, теперь активно подрывает их ИИ-будущее, на которое они рассчитывают.

«Происходит следующее: соотношение сигнал-шум обваливается, — говорит Дэниел Кимбер, генеральный директор австралийского стартапа Brainfish AI, специализирующегося на создании агентов ИИ. — Исходные человеческие рассуждения, знания о частных случаях и тонкий институциональный контекст размываются синтетическим контентом, который уже представляет собой абстракцию чего-то реального. Когда вы обучаете или дорабатываете модель на этих данных, вы учитесь ее не на опыте, а на копии копии».

Конечным результатом отравления данных является риск, о котором многие CIO, возможно, уже знают: деградация модели. Однако сведение проблемы просто к «деградации модели» может скрывать то, что действительно стоит на кону — бизнес-результаты. Деградация модели может привести к деградации решений, которая происходит, когда решения — принимаемые машинами или людьми — основаны на искаженных анализе или результатах работы ИИ.

«Потеря точности — это больше, чем деградация, это искажение. Проблемы обычно не проявляются линейно, а накапливаются незаметно и срабатывают одновременно, — говорит Збынек Сопух, технический директор ИБ-компании Safetica. — Потеря точности и петли обратной связи приводят к деградации решений в масштабе. Это означает, что вы переходите от проблемы модели к проблеме бизнеса».

Отравление данных также может привести к удивительному разнообразию проблем, связанных с юридическим правом, соблюдением нормативных требований и институциональными знаниями. Согласно исследованию моделей ИИ, опубликованному в Nature.com в 2024 г., вызванная отравлением деградация данных необратима. Более того, по словам Дэна Ивцана, старшего директора по ИИ-продуктам компании Steno, поставщике юридического ИИ, это также приводит к потере «тонких, редких институциональных знаний, находящихся в хвостах распределения данных».

«Засада в том, что беглость сохраняется, в то время как фактическая точность снижается, поэтому стандартные тесты полностью ее не учитывают», — добавляет он.

Помимо потери точности, организации могут столкнуться с усилением предвзятости из-за таких факторов, как исчезновение данных, относящихся к группам меньшинств, и гомогенизация результатов, то есть их сближение с усредненным значением.

«В юридическом ИИ это смещение может означать искаженные цитаты или неверные медицинские хронологии. Это реальный риск судебных исков о врачебной халатности, — говорит Ивцан. — Проверенный способ их предотвращения: всегда накапливайте реальные данные наряду с синтетическими. Никогда не заменяйте их».

Опасности повторяющихся циклов обратной связи

Отравление данных снижает ценность исходных данных, отмечает Рёдзи Мории, основатель токийской компании Insynergy.io, специализирующейся на управлении ИИ и архитектуре принятия ИИ-решений: «Данные рассматриваются как одноразовый ресурс, и вместо них используются производные значения. Это загрязняет обучающие данные и делает исходные данные менее релевантными».

Вину за проблему можно возложить на корпоративную потребность в скорости, инстинктивное стремление людей к самому простому или просто на непонимание того, как на самом деле работает обучение и тонкая настройка ИИ. Независимо от причины или намерения, вред неоспорим.

«То, что здесь описывается, — это „отравление данных во имя удобства“. Это не злонамеренно, но приведет к долгосрочному ущербу», — говорит Сопуч.

Возложение вины на кого-либо имеет не такое большое значение, как способность осознать опасность сейчас.

«На ранних этапах вы часто этого не замечаете: результаты выглядят нормально, контроль качества тоже пройден», — говорит Четан Саунданкар, генеральный директор индийской компании Coditation, которая разрабатывает и внедряет системы ИИ для корпоративных клиентов.

Но это затишье перед бурей. «Через несколько недель или месяцев модель начинает ошибаться, причем ошибки трудно заметить, потому что ответы по-прежнему звучат вполне разумно, — отмечает он. — Инструмент для анализа кода начинает предлагать шаблоны, которые работают, но имеют уязвимости в системе безопасности. Модель обобщения начинает отбрасывать уточнения и нюансы, которые делали исходные документы полезными, сохраняя при этом авторитетный тон».

Проблемы проникают во все важные аспекты деятельности успешной и прибыльной организации. Небольшие неточности, такие как неправильная оценка распределения ресурсов в облачных и инфраструктурных средах или неверная маркировка шаблонов использования, могут быстро накапливаться, объясняет Дирк Альшут, директор по маркетингу люксембургской платформы управления облачными ресурсами Emma. В конечном итоге эти ошибки увеличивают затраты или приводят к снижению производительности с течением времени. «Обратная связь усугубляет ситуацию, потому что те же самые ошибочные результаты могут быть зарегистрированы и использованы повторно, закрепляя ошибку», — добавляет он. Это может оказать потенциально огромное влияние на бизнес.

Еще одна проблема, которую заметил Альшут, — это потеря адаптивности. «ИИ, обученный на ИИ-выдаче, как правило, испытывает трудности, когда происходит что-то новое или неожиданное, потому что он не сталкивался с реальной вариативностью», — говорит он.

По его словам, лучшая профилактика — это привязка обучающих данных к реальному поведению системы. «Используйте телеметрию реального времени, журналы и решения, проверенные людьми, в качестве источника достоверной информации и рассматривайте результаты, сгенерированные ИИ, как временные, а не основополагающие», — советует Альшут.

Надвигающийся коллапс модели

CIO необходимо понимать, что проблема отравления данных не заканчивается деградацией модели. Обучение на контенте, сгенерированном ИИ, может привести к «коллапсу модели», когда системы ИИ в конечном итоге полностью выходят из строя. По сути, это сводит инвестиции в ИИ к «убыткам от порчи» — они возникают, когда проекты становятся бесполезными до такой степени, что их невозможно восстановить, учитывая деградацию модели, данных и результатов.

«Коллапс модели — это деградация, которая происходит, когда модели многократно обучаются на результатах других моделей. Со временем система становится более повторяющейся, менее детализированной и менее отражающей реальный мир», — объяснил Оли Остертаг, президент по платформам роста и ИИ компании PAR Technology, поставщике унифицированных коммерческих платформ для ресторанов и ритейла.

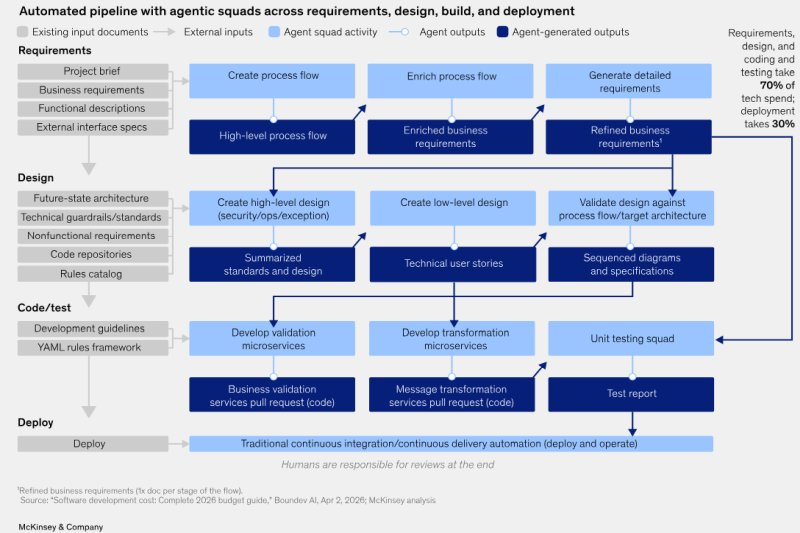

Даже если организации развертывают вендорские ИИ-решения, причина коллапса может быть внутренней. «Разговоры о загрязнении данных ИИ, как правило, сосредоточены на обучении базовых моделей, то есть на том, как обучают OpenAI или Google, — говорит Кимбер. — Но более насущная проблема для большинства организаций возникает на один уровень ниже, в их собственной инфраструктуре знаний. Каждая компания теперь, по сути, занимается обучением моделей».

Восстановление модели и внедрение мер защиты

Первый шаг в решении проблемы отравления данных — это предотвращение ее усугубления. К счастью, есть способ восстановить производительность во время или после сбоя модели, хотя это требует значительных усилий. Профилактика всегда предпочтительнее, но если произошел сбой, решение состоит в переобучении на чистых данных для восстановления производительности, говорит Ивцан.

Как утверждают авторы статьи, сбоя можно избежать, если реальные данные накапливаются наряду с синтетическими данными, а не заменяются ими. Согласно другой статье, даже несовершенная внешняя проверка может стабилизировать траекторию. В этом контексте «несовершенство» внешней проверки не означает использование источников или информации, которые могут быть ошибочными или неверными. Это означает использование таких методов, как выборочные проверки, экспертная оценка или основанное на опыте человеческое суждение, которые сами по себе не являются тщательной проверкой фактов, но все же, скорей всего, будут очень точными. Масштабная, целенаправленная проверка превосходит как полное отсутствие контроля, так и непрактичность исчерпывающей проверки фактов.

Лучший вариант действий, если это возможно, — предотвращение.

«Способ предотвратить это — проектировать системы с обратной связью человек-машина. Самые сильные системы — итеративные, человек-ИИ, ИИ-человек, где результаты постоянно формируются, проверяются и совершенствуются», — объясняет Кааре Веснаес, руководитель отдела инноваций агентства Ogilvy North America, занимающегося созданием брендов для компаний Fortune Global 500. Короче говоря, «самые сильные системы полагаются не только на ИИ. Они включают циклы человек-машина», — говорит он.

Главная идея заключается в том, чтобы помнить, что ИИ хорош настолько, насколько хороши его данные, и действовать соответственно.

«Компаниям необходимо защищать целостность своих данных. Это означает приоритетное использование высококачественных входных данных, созданных человеком, четкое разграничение синтетических и реальных данных и постоянное повторное внедрение в свои системы новых сигналов из реального мира», — считает Веснаес.