Недавний триумф компании Fujitsu, которой с ее системой K computer удалось буквально ворваться в число мировых грандов HPC, многие эксперты оценили как одно из важнейших событий отрасли в минувшем году. И дело не только в том, что машина сейчас занимает первую строчку рейтинга Top 500 с огромным отрывом от конкурентов. Речь в таких случаях почти всегда идет о том, что компании удалось найти какие-то новые подходы, новые технологические решения и предложить новое видение рынка.

Обо всем этом со старшим консультантом Fujitsu по высокопроизводительным вычислениям Вольфгангом Гентшем побеседовал обозреватель PC Week/RE Денис Воейков.

PC Week: Какие технологические тенденции отрасли, наметившиеся или укрепившиеся в 2011 г., вы бы выделили?

Вольфганг Гентш: В ушедшем году мы наблюдали эволюционное развитие — сохранение основных тенденций на рынке высокопроизводительных вычислений (HPC) последних лет. HPC становятся интереснее и разнообразнее благодаря новым поколениям процессоров с удвоенным числом ядер и их различным архитектурам (таким как Intel Sandy Bridge и AMD Interlagos, Fujitsu SPARK64 IX и IBM Power 7), а также разработанному в Китае новому дизайну процессоров.

Также мы видим растущее использование графических процессоров (GPU) Nvidia и AMD в качестве ускорителей и появление процессора MIC Intel. GPU при этом представляют основу гибридных архитектур и гибридного программирования с помощью CUDA, OpenMP и MPI.

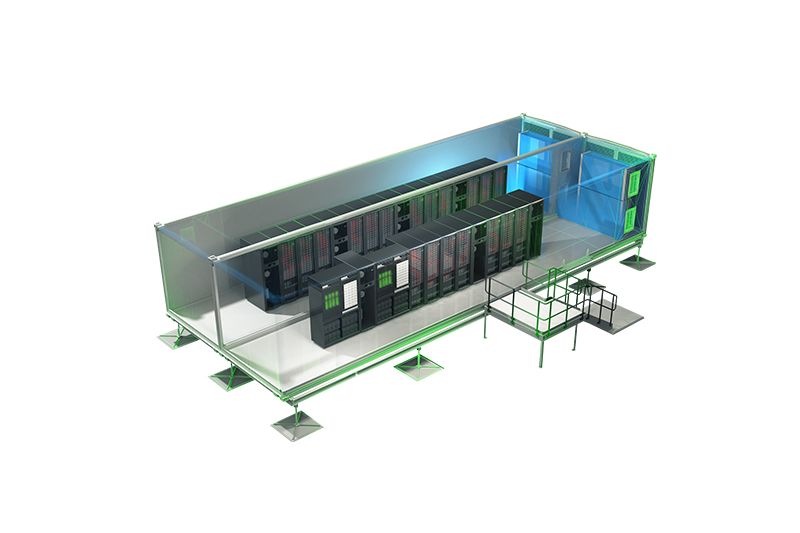

Еще можно отметить появление экологически чистых HPC. Речь идет об уменьшении потребления энергии в расчете на одну операцию (или Вт на флопс), а также о снижении расхода энергии на охлаждение и даже об использовании выделяемого аппаратурой тепла. Кроме того, становится популярным использование более дешевых или альтернативных источников энергии (в зависимости от местонахождения машин) и сокращение занимаемых системами площадей.

Все шире распространяются облачные вычисления. Здесь речь идет не столько о технологии (за исключением высокоэффективных ЦОДов для HPC), сколько о доступе к сервисам HPC, а если взглянуть на это с другой стороны, то о способе предоставления HPC конечному пользователю.

Это, скорее, новая модель бизнеса и предоставления услуг, чем новая технология. Имеется в виду предоставление HPC в качестве сервиса через сеть (по запросу и с оплатой за фактическое использование ресурсов), причем клиент обходится только браузером.

Наконец, нужно упомянуть о данных, о больших данных. В нынешних архитектурах слишком много узких мест между процессорами, системами хранения и сетями, чтобы они могли эффективно обрабатывать огромные массивы данных, а также фиксировать, хранить, вести их поиск, организовывать коллективный доступ, анализировать, визуализировать и сохранять данные должным образом. В ближайшее время в этой области появится множество нововведений.

PC Week: Как вы считаете, какая архитектура HPC будет положена в основу машин с быстродействием порядка экзафлопса? Будет ли это архитектура с большим количеством легковесных ядер (развитие идей BlueGene), гибридная архитектура с использованием графических ускорителей или что-то иное?

В. Г.: В сущности, я уже ответил на этот вопрос. Для экзафлопсной эпохи будет все труднее разработать и создать единую полностью гомогенную архитектуру. Достаточно посмотреть на нынешние тенденции развития петафлопсных вычислений (1015 операций с плавающей запятой в секунду). Все меньше систем являются гомогенными по своей природе — строятся ли они на базе архитектуры x86, Power PC или SPARC. Для преодоления рубежа петафлопсной производительности большинство из них уже сейчас содержит дополнительные ускорители вроде GPU. И такая тенденция, несомненно, сохранится. Хотя надо понимать, что, с точки зрения программиста, это, конечно, плохо, поскольку требует дополнительного переписывания части существующего кода.

Одним выдающимся исключением является нынешний № 1 в списке мощнейших суперкомпьютеров мира Top 500 — Fujitsu K с гомогенной архитектурой на процессорах SPARC и сложным шестимерным межсоединением Mesh/Torus с гигантской вне-чиповой полосой пропускания в 100 Гбит/с, что позволяет свести к минимуму задержки при обмене информацией, повысить масштабируемость и отказоустойчивость. Такая архитектура реализована теперь и в недавно представленной системе PRIMEHPC с производительностью 23 Пфлопс.

Разумеется, я не единственный, кого весьма интересует, в какой степени эта архитектура сможет масштабироваться в направлении экзафлопсных вычислений в ближайшие годы…

PC Week: Существует мнение, что эффект от использования GPU сильно преувеличен и гибридные системы способны решать только узкий круг реальных задач. А вы что думаете по этому поводу?

В. Г.: С одной стороны, если посмотреть на наше научное сообщество и рост исследований в области гибридных алгоритмов, приложений и языков, проводится большая работа с языками для GPU — CUDA и OpenMP ARB, со стандартом OpenACC. Сообщество разработчиков OpenCL формирует подход к ускорителям, основанный на стандартах. По всем этим направлениям достигнуты неплохие результаты. Поэтому я не думаю, что потенциал архитектуры GPU сильно переоценен.

С другой стороны, я считаю, что мы, продвигаясь к более полной интеграции в области как аппаратуры, так и ПО, пока находимся только на середине пути. Но здесь, мне кажется, все очевидно. В обозримом будущем я предвижу тесную интеграцию процессоров с некоторыми GPU или даже конструкцию в виде тандема, в которой у каждого процессорного ядра будет свой ускоритель. Например, подобно тому как в прошлом скалярные процессоры снабжались векторными, причем векторизирующие компиляторы могли автоматически векторизировать часть кода, требующую интенсивных вычислений.

PC Week: В технологическом плане с какой главной проблемой необходимо справиться разработчикам, чтобы существенно возросла производительность суперкомпьютеров и в отрасли произошел качественный рывок вперед?

В. Г.: Я не вижу на горизонте какой-то магической технологии. Во всяком случае, в ближайшем будущем она не появится. Предстоит немало поработать. Все будет развиваться эволюционно. Продолжится совершенствование процессоров, доступа к кэшу, скорости межсоединений, способов устранения узких мест при обращении к памяти и программирования этих элементов. Здесь уже просматривается успех, как я упоминал ранее, с архитектурой PRIMEHPC. Необходимо улучшить масштабируемость этих гигантских систем, обмен информацией и отказоустойчивость. Дополнительную надежду на прогресс дают новые математические и числовые алгоритмы. Они позволят создать более подходящие модели данных для совершенствования ввода/вывода и непрерывной обработки.

PC Week: Каково ваше отношение к рейтингу Top 500, в частности к тесту Linpack? Насколько он адекватно, на ваш взгляд, позволяет оценить потенциал кластера для решения реальных задач? Имеет ли смысл тратить силы на специальную настройку вычислителя для прохождения этого теста? Насколько имиджевая составляющая участия в Top 500 реально важна для коммерческих компаний, научных и академических организаций?

В. Г.: Все мы знаем пределы возможностей теста Linpack и списка Top 500, так что ничего необычного здесь нет. Это просто одна из специальных программ для решения больших систем алгебраических уравнений, и все. Это как “Формула-1” — очень специфические машины для специфических гонок… Разумеется, Linpack довольно часто используется во многих специальных приложениях, главным образом для моделирования физических явлений. Но это лишь одна программа с одним специфическим алгоритмом. Невозможно, например, руководствоваться только Linpack при проектировании аппаратуры и программных систем следующего поколения, как иногда ошибочно утверждается. Это был бы слишком примитивный подход.

При выборе новой большой системы все директора вычислительных центров используют специальные тестовые пакеты, которые с высокой точностью показывают повседневную производительность конкретного вычислителя. Это далеко выходит за рамки сравнения по результатам теста Linpack и рейтинга Top 500. Это программы тестирования, разработанные с учетом реального использования. И производительность именно при выполнении данных программ определяет, будет или нет рассматриваться возможность приобретения системы.

Что касается рейтинга Top 500, то мы, люди, любим спорт, любим соревнования, любим сравнивать с “Формулой-1”. Linpack и Top 500 привносят дополнительный человеческий элемент в высокопроизводительные вычисления, которые без них были бы совершенно лишены эмоций, и это прекрасно!

PC Week: Как вы оцениваете объективность альтернативных тестов и что вы думаете о новом тесте Graph 500?

В. Г.: Graph 500 – это просто еще один специальный тест. В отличие от Linpack, предназначенный для операций с плавающей запятой, он хорошо подходит для многих задач, в которых интенсивно используются данные, как, например, в бизнес-аналитике или в работе со сверхбольшими объемами информации. Поэтому руководящий комитет Graph 500 разрабатывает всеобъемлющие тесты для решения трех видов базовых задач: параллельный поиск, оптимизация (нахождение кратчайшего пути к единому источнику) и поиск кратчайших путей в графе (максимального множества независимых вершин). Они хорошо подходят для приложений в области кибербезопасности, медицинской информатики, обогащения данных, социальных и символических сетей. Из этого вы можете заключить, что Graph 500 не является альтернативой для HPC, а просто предназначен для совершенно иного набора приложений.

PC Week: Можете ли вы прокомментировать недавний анонс Fujitsu решения PRIMEHPC FX10 (развитие идей, ставших основой кластера K computer), которое в зависимости от потребностей заказчика может иметь конфигурации с пиковой производительностью вплоть до 23,2 Пфлопс?

В. Г.: К computer стал большим сюрпризом на международной конференции по суперкомпьютерам в Гамбурге в июне прошлого года. Почти сразу же после трагической череды катастроф в Японии, которые привели помимо прочего к прискорбному сокращению промышленного производства в целом, никто не ожидал, что Fujitsu вовремя поставит K computer исследовательскому центру RIKEN. И никто не ожидал, что K окажется в три с лишним раза быстрее второй по быстродействию машины, показав производительность свыше 8 Пфлопс. И в довершение всего как раз перед открытием суперкомпьютерной выставки в Сиэтле в ноябре K стал первым компьютером, преодолевшим рубеж в 10 Пфлопс, а Fujitsu анонсировала его коммерческий вариант PRIMEHPC FX10. На этой выставке K получил наивысшие оценки во всех четырех тестах производительности на престижной церемонии 2011 HPC Challenge Awards за обслуживание больших исследовательских моделей. Его пиковая производительность намного превысила магический рубеж в 1 Пфлопс. Это выглядело как слаженная игра большого оркестра.

Поскольку уже раньше многие другие системы из списка Top 500 оснащались GPU-ускорителями, настоящим сюрпризом для меня стало то, что компьютеры серии PRIMEHPC имеют солидную и хорошо спроектированную гомогенную архитектуру с использованием передовых компонентов, таких как 16-ядерный процессор SPARC64 и 6-мерное межсоединение Mesh/Torus Tofu. Компиляторы и библиотеки тщательно настроены под данную архитектуру. PRIMEHPC поднимает планку для конкурентов выше, чем любая другая система с тех пор, как в 2002 г. Japanese Earth Simulator в четыре раза превзошел ASCI White и в течение трех с лишним лет занимал первую позицию. Интересно будет посмотреть, как теперь, после возвращения Fujitsu в сферу высокопроизводительных вычислений, конкуренты станут догонять ее в области исследований и производства.

PC Week: Спасибо за беседу.