Технологический прогресс в сочетании с желанием бизнеса улучшить бизнес-процессы приближает нас к внедрению новой разновидности ИТ-инфраструктуры. Генеральный директор Hazelcast Келли Херрел поведал порталу InformationWeek о выгодах применения технологии периферийных вычислений, а также о проблемах, которые мешают ее массовому внедрению.

Всегда движимый поиском чего-то нового, макро-дизайн ИТ-архитектур прошел долгий путь, то тяготея к централизованной инфраструктуре, то к децентрализованной. К настоящему времени верх удалось взять централизованной инфраструктуре — облачной. Между тем одновременно развивается другая мощная противодействующая сила: технология периферийных вычислений (Edge computing), которая оперирует с данными на границе сети.

Начиная с автомобилей и заканчивая промышленным оборудованием, данные сегодня возникают с удивительной скоростью, затрагивая все больше областей. Фактически, за последние два года было создано 90% объема мировых данных. По оценкам Techjury, к концу этого года накопленный объем данных составит около 40 триллионов гигабайт, при этом скорость генерации составит 1,7 Мб данных на человека в секунду. Как подсчитала Juniper Research, к 2022 г. число подключенных устройств вырастет на 140%, достигнув 50 млрд.. Они будут генерировать беспрецедентно большой объем информации, которого раньше человечество не знало. В 2017 г. журнал Economist заявил, что данные стали самым ценным ресурсом, заменив нефть, однако пока что их ценность по-настоящему не раскрыта — она выражается единицами процентов от общего объема данных.

Однако к 2025 г. ситуация изменится. Согласно прогнозам Strategy Analytics, 59% данных, продуцируемых устройствами Интернета вещей (IoT), будут обрабатываться при помощи технологии периферийных вычислений. Обоснование для ее применения следующее: она улучшает пропускную способность сетей (снижает латентность) и уменьшает стоимость транспортировки данных. И тот, и другой показатель указывают на необходимость обработки данных в режиме реального времени и из любого места. По мере того, как современный мир становится цифровым и подключенным, а приложения — гораздо требовательнее к вычислительным ресурсам, потребность в Edge computing становится жизненно важной.

Edge-вычисления становятся реальностью

Все это подводит к вопросу: как периферийные вычисления воплотить в реальность? Ответ на него заключается в необходимости широкомасштабного развертывания инфраструктуры нового типа. Среди ее основных элементов — размещение на краю сети физических вычислительных компонентов. Их географическое расположение и плотность размещения будут зависеть от варианта применения, но маловероятно, что большинство предприятий отважатся взять на себя эти затраты. Скорее всего, они будут строить расчет на том, что за обустройство периферийной инфраструктуры возьмутся крупные поставщики услуг, действуя в рамках своих облачных и edge-стратегий.

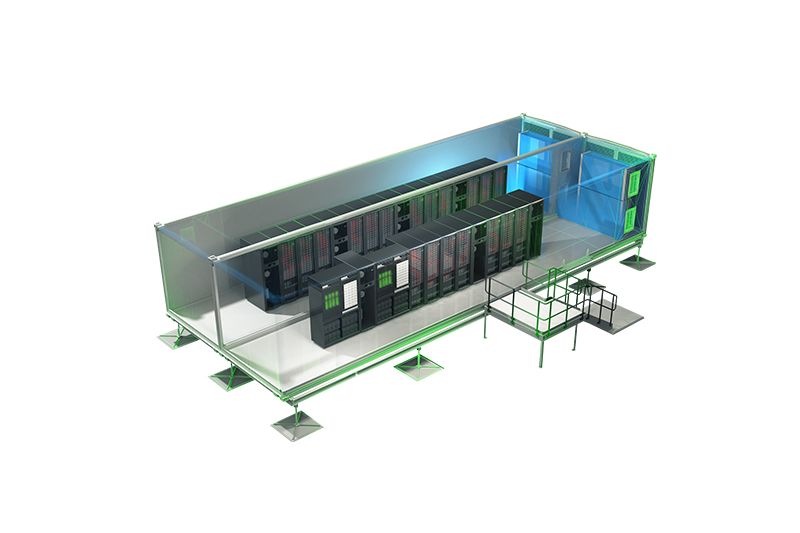

Одним из таких примеров является инициатива AT&T CORD (Central Office Redesigned as Datacenter), которая легла в основу эволюции архитектуры компании. Помимо AT&T за переустройство инфраструктуры взялись и другие крупные облачные игроки, которые дополнили свои огромные централизованные дата-центры периферийными ЦОДами. Не исключено, что концепция микро-ЦОДов, которые разворачиваются на базовых станциях сотовой связи, вскоре станет реальностью.

Микро-ЦОДы открывают возможности для разворачивания многоуровневых архитектур, при этом наиболее чувствительные к пропускной способности варианты применения будут располагать небольшими вычислительными блоками. Последние могут находиться в непосредственной близости к девайсу, передавая с него данные в кэш или хранилища данных, которые находятся в периферийных дата-центрах.

Развертывание edge-инфраструктуры предусматривает два сценария. В первом случае обработка данных, которые генерируют устройства, будет осуществляться локально, без отправки в корпоративное облако или удаленный ЦОД. Этот метод может оказаться особенно полезным для регионов, где законодательство о защите персональных данных запрещает трансграничное перемещение конфиденциальной информации о пользователях. В другом случае обработка чувствительных к пропускной способности данных будет осуществляться на границе сети с асинхронной передачей результатов в удаленные системы.

Данные в масштабе

Низкая латентность и обработка больших объемов данных — это два ключевых компонента для реализации Edge computing как технологии. Несмотря на текущие проблемы, отраслевые лидеры должны сплотить усилия для стандартизации путей применения и обработки данных многочисленными поставщиками услуг, что позволит устранить задержки при передаче трафика на дальние расстояния, стать основой для зарождения нового поколения стратегических приложений, а также адаптироваться к развивающейся ИТ-инфраструктуре. Прежде, чем поставить периферийные вычисления на службу бизнесу, нужно разработать технику для масштабирования потоковых данные, которые поступают из множества типов устройств, и их обработки в многоуровневых кэшах или хранилищах данных.

Нужно заметить, что существующие технологии — как аппаратные, так и программные — это позволяют. Вдобавок ко всему, компании начинают проявлять творческий подход для прототипирования edge-приложений, пытаясь извлечь выгоду из надвигающейся волны периферийных вычислений. Компании-первопроходцы, которые продемонстрируют жизнеспособность технологии, запустят цепную реакцию массовых внедрений, продемонстрировав, что у облака появился конкурент.

Несмотря на то, что облако по-прежнему доминирует, ИТ-рынок подходит к переломному моменту — появлению нового поколения инфраструктуры, которая приведет к глубоким изменениям во всех отраслях.