Подавляющее большинство систем агентного искусственного интеллекта ничего не сообщают о том, проводились ли у них какие-либо испытания на безопасность, и многие системы не имеют документально подтвержденного способа остановить несанкционированного бота, показало исследование «The 2025 AI Index: Documenting Sociotechnical Features of Deployed Agentic AI Systems», в котором приняли участие представители сразу нескольких университетов, сообщает портал ZDNet.

Технология агентов полностью входит в мейнстрим ИИ после объявления о том, что OpenAI наняла Питера Штейнберга, создателя программного Open Source-фреймворка OpenClaw.

OpenClaw недавно привлек большое внимание не только благодаря своим выдающимся функциям — например, агенты могут отправлять и получать электронные письма от вашего имени, — но и из-за серьезных недостатков в его безопасности, включая возможность полного захвата вашего персонального компьютера.

Учитывая интерес к агентам и то, как мало до сих пор известно об их преимуществах и недостатках, важно, что исследователи из Массачусетского технологического института, Кембриджского университета, Вашингтонского университета, Гарвардского университета, Стэнфордского университета, Пенсильванского университета и Еврейского университета в Иерусалиме опубликовали масштабный обзор 30 наиболее распространенных агентных систем ИИ.

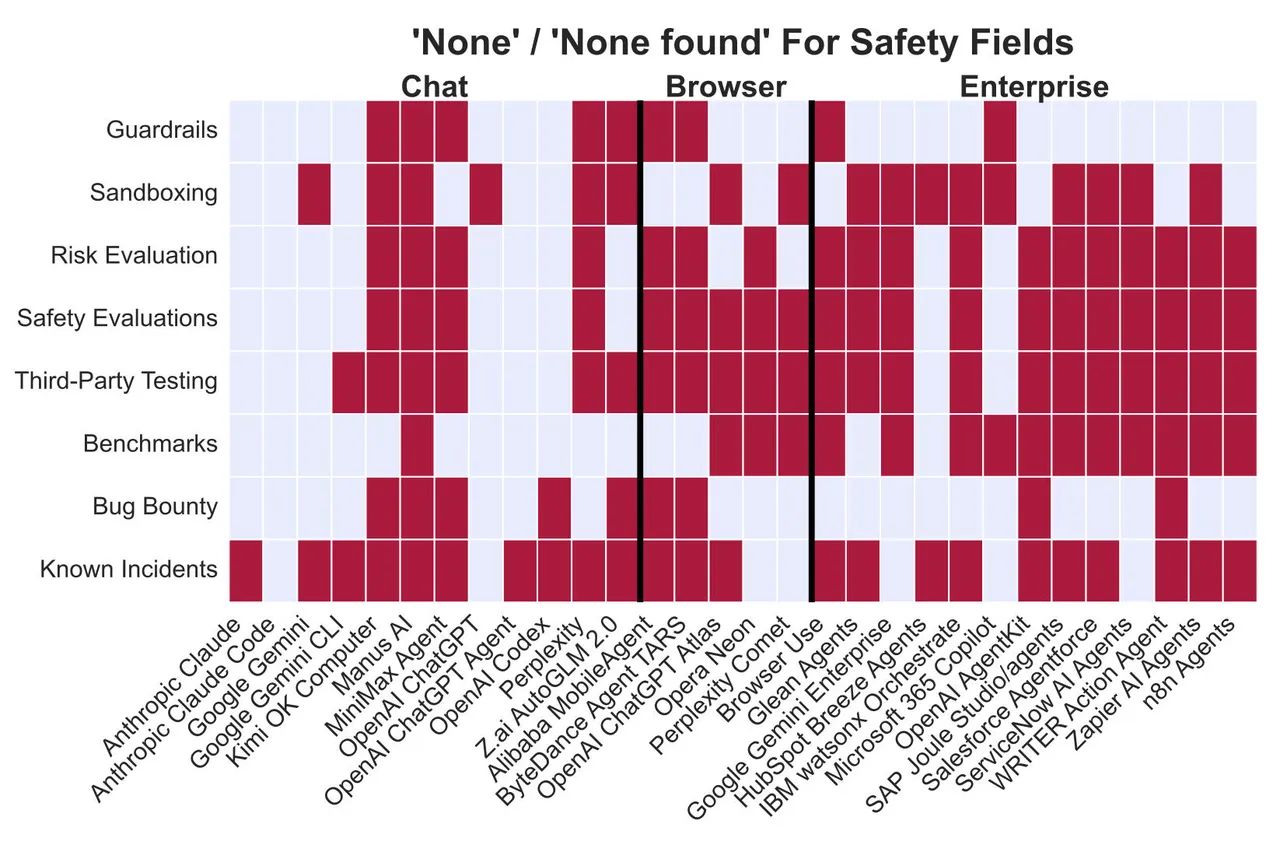

Результаты ясно показывают, что агентный ИИ в настоящее время представляет дисциплину, характеризующуюся недостатком информации, отсутствием прозрачности, поразительным отсутствием базовых протоколов о том, как должны работать агенты, и являющуюся настоящим кошмаром с точки зрения безопасности.

Отсутствие прозрачности

Самое важное открытие исследователей заключается в том, что выявить все потенциальные проблемы, которые могут возникнуть в агентном ИИ, крайне сложно. Это в основном результат недостаточной открытости разработчиков.

«Мы выявили устойчивые ограничения в отчетности относительно экосистемных и связанных с безопасностью характеристик агентных систем», — сообщают исследователи.

Большинство агентных систем вообще не предоставляют никакой информации по большинству категорий раскрытия информации. Упущения варьируются от отсутствия информации о потенциальных рисках до отсутствия информации о стороннем тестировании, если таковое имело место.

Отчет полон ценных сведений о том, как мало возможностей для отслеживания, мониторинга и контроля в современных технологиях агентного ИИ. Например, «для многих корпоративных агентов из общедоступной информации неясно, существует ли мониторинг отдельных трассировок выполнения», что означает отсутствие четкой возможности отслеживать, что именно делает программа агентного ИИ.

«Двенадцать из тридцати агентов не предоставляют мониторинга использования или только выдают уведомления, когда пользователи достигают лимита скорости», — отмечают авторы. Это означает, что вы даже не можете отслеживать, сколько вычислительных ресурсов потребляет агентный ИИ — ключевая проблема для предприятий, которые должны его бюджетировать.

Большинство этих агентов также не сообщают реальному миру, что они являются ИИ, поэтому невозможно узнать, имеете ли вы дело с человеком или с ботом. «Большинство агентов по умолчанию не раскрывают конечным пользователям или третьим сторонам свою ИИ-природу», — пишут исследователи. Раскрытие информации в данном случае включает в себя такие вещи, как нанесение водяного знака на сгенерированный файл изображения, чтобы было ясно, что изображение было создано с помощью ИИ, или реагирование на файл «robots.txt» веб-сайта для идентификации агента как автоматизации, а не как человека-посетителя.

Некоторые из этих программных инструментов не предоставляют возможности остановить работу конкретного агента. MobileAgent от Alibaba, Breeze от HubSpot, watsonx от IBM и автоматизации, созданные берлинским разработчиком n8n, «не имеют документированных вариантов остановки, несмотря на автономное выполнение, — сообщают авторы. — У корпоративных платформ иногда есть только возможность остановить всех агентов или отменить развертывание».

Обнаружение того, что вы не можете остановить что-то, что делается неправильно, — это, пожалуй, один из худших возможных сценариев для крупной организации, где вредные последствия автоматизации перевешивают ее преимущества.

Авторы ожидают, что эти проблемы агентов, а именно проблемы прозрачности и контроля, сохранятся и даже станут более заметными. «Проблемы управления, описанные здесь (фрагментация экосистемы, отсутствие оценок для конкретных агентов и др.), будут приобретать все большее значение по мере увеличения возможностей агентов», — пишут они.

Исследователи также заявили, что в течение четырех недель они пытались получить обратную связь от компаний, чье ПО рассматривалось в отчете. Им ответила примерно четверть, «но только три из тридцати дали содержательные комментарии», которые были включены в отчет.

Расширяющийся ландшафт агентного ИИ

Агентный ИИ — это ветвь машинного обучения, которая появилась в последние три года для расширения возможностей больших языковых моделей и чат-ботов.

Вместо того чтобы просто выполнять задания, полученные в текстовом виде, агенты представляют собой ИИ-программы, которые подключены к внешним ресурсам, таким как базы данных, и которым предоставлена определенная степень «автономии» для достижения целей, выходящих за рамки текстового диалога.

Такая автономность может включать выполнение нескольких этапов корпоративного рабочего процесса, например, получение заказа на покупку по электронной почте, его внесение в базу данных и проверку наличия товара в системе учета запасов. Агенты также используются для автоматизации нескольких этапов взаимодействия с клиентами, чтобы заменить обработку некоторых базовых телефонных, почтовых или текстовых запросов, которую традиционно выполняет оператор службы поддержки.

Авторы выбрали для исследования агентный ИИ трех категорий: чат-боты с дополнительными возможностями, такие как инструмент Claude Code от Anthropic; расширения для веб-браузеров или специализированные ИИ-браузеры, такие как браузер Atlas от OpenAI; и корпоративные программные продукты, такие как Microsoft Office 365 Copilot. Это небольшая выборка: другие исследования, как они отмечают, охватывают сотни предложений в области агентных технологий.

Однако большинство агентов «полагаются на небольшой набор закрытых моделей», отмечают исследователи. Большинство этих агентов построены на основе GPT от OpenAI, Claude от Anthropic и Gemini от Google.

Преимущества и недостатки агентов

Исследование не основано на прямом тестировании агентных инструментов; оно основано на «аннотировании» документации, предоставленной разработчиками и поставщиками. Оно охватывает «только общедоступную информацию из документации, веб-сайтов, демонстраций, опубликованных статей и управленческих документов», заявляют авторы отчета. Однако они создали учетные записи пользователей в некоторых агентных системах, чтобы перепроверить фактическое функционирование ПО.

Авторы приводят три примера, которые позволяют более подробно рассмотреть проблему. Положительным примером, как они пишут, является ChatGPT Agent от OpenAI, который может взаимодействовать с веб-сайтами, когда пользователь запрашивает в промпте выполнение веб-задачи. Он выделяется тем, что является единственной из рассмотренных исследователями агентных систем, которая предоставляет средства отслеживания поведения путем «криптографической подписи» запросов к браузеру.

В отличие от этого, веб-браузер Comet от Perplexity выглядит как катастрофа в области безопасности. Программа, как обнаружили исследователи, «не имеет оценок безопасности, специфичных для агента, сторонних тестов или раскрытия информации о производительности», и «Perplexity [...] не задокументировала методологию оценки безопасности или результаты для Comet», кроме того «не было задокументировано никаких подходов к изоляции или сдерживанию, кроме мер по смягчению последствий инъекции промптов».

Авторы отмечают, что Amazon подала в суд на Perplexity, заявив, что браузер Comet ошибочно представляет свои действия серверу, как если бы это был человек, а не бот, что является примером отсутствия идентификации, о которой они говорят.

Третий пример — набор агентов Breeze от поставщика корпоративного ПО HubSpot. Это автоматизированные системы, которые могут взаимодействовать с учетными системами, такими как «управление взаимоотношениями с клиентами». Инструменты Breeze, как выяснилось, представляют собой смесь хорошего и плохого. С одной стороны, они сертифицированы в плане соблюдения множества корпоративных требований, таких как SOC2, GDPR и HIPAA. С другой стороны, HubSpot недостаточно раскрывает информацию о тестировании безопасности. Разработчик говорит, что агенты Breeze были оценены сторонней компанией по безопасности PacketLabs, «но не приводит никакой методологии, результатов или подробной информации о тестировании».

Практика демонстрации соответствия нормативным требованиям, но не раскрытия реальных результатов оценки безопасности, «типична для корпоративных платформ», отмечают исследователи.

Пришло время разработчикам взять на себя ответственность

В отчете не рассматриваются инциденты в реальных условиях, случаи, когда агентная технология действительно приводила к неожиданному или нежелательному поведению, которое в итоге выливалось в нежелательные последствия. Это означает, что мы еще не знаем полного влияния недостатков, выявленных авторами.

Но одно совершенно ясно: агентный ИИ — это продукт конкретных решений, принимаемых командами разработчиков. Эти агенты — инструменты, созданные и распространяемые людьми.

Таким образом, ответственность за документирование ПО, за аудит программ на предмет безопасности и за предоставление мер контроля лежит исключительно на OpenAI, Anthropic, Google, Perplexity и других ИИ-организациях. Им предстоит предпринять шаги для устранения выявленных серьезных недостатков, иначе в будущем им придется столкнуться с ужесточением регулирования.